Dex-Net AR使用苹果公司的ARKit训练机器人来抓取物体

加州大学伯克利分校的AI研究人员正在使用iPhone X和苹果公司的ARKit来训练机械臂如何抓住物体。它是Dex-Net AR的一部分,Dex-Net AR是使用商用智能手机进行机器人抓取的管道。ARKit通过将RGB摄像机在对象周围移动两分钟而生成的数据来创建点云。

机器人抓取是一个特定的机器人子领域,其重点是教导机器人拾取,移动,操纵或抓握物体的挑战。加州大学伯克利分校的Autolab的敏捷网络研究(Dext-Net)可以追溯到2017年,包括开源培训数据集和预先训练的模型,用于在电子商务垃圾桶拣选场景中进行机器人抓取。机器人快速学习如何抓取物体的能力对像亚马逊配送中心这样的自动化仓库的发展产生了重大影响。

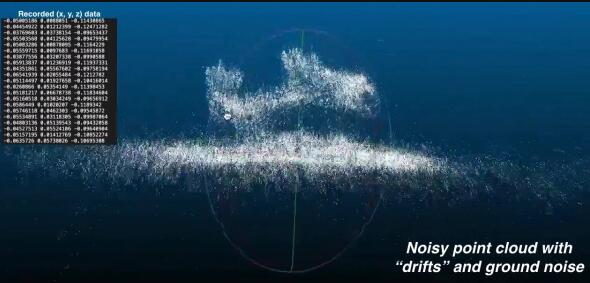

在实验室中对八个物体的早期实验中,Dex-Net AR将ARKit扫描转换为深度图,以供ABB YuMi机器人抓取物体,成功率为95%。每次扫描都会创建一个点云。

“随着相机在空间中移动,点云的密度增加,可以更好地检测和定义物体的表面以进行抓取,”最近发表的一篇详细介绍Dex-Net AR的论文。“ Dex-Net AR可以产生精确的掌握,类似于依靠昂贵的工业级深度传感器的最新系统。与从固定视图(通常是自顶向下)捕获图像的深度相机系统相比,Dex-Net AR允许用户将智能手机相机移动到整个对象周围,收集三维点云数据。”

Dex-Net AR使用离群值去除算法和k最近邻算法清除ARKit点云中估计误差引起的噪声。然后,Dex-Net抓取计划器评估机器人应如何拾取物体。

由于每个ARKit扫描每个对象花费固定的两分钟,因此在将来的研究中,研究人员将寻找更快扫描对象的方法。该论文说:“潜在的改进是,我们可以使用基于学习的方法来尝试减少视频捕获的时间,以补充和完善点云数据,前提是只有有限的数据可用。”研究人员还计划探索如何更好地利用iPhone X深度感应相机来收集更清晰的点云数据。

Dex-Net AR上周在国际机器人与自动化会议(ICRA)上推出。会议上发表的其他论文包括探索为人类和四足机器人行走的下半身骨骼行走的理想方法的作品。斯坦福大学的一个实验室共享了一个多无人机管理系统,该系统利用公共巴士来降低运输成本和能耗。Google Brain,英特尔AI实验室和Autolab也推出了Motion2Vec,这是经过AI培训的AI,可通过视频观察进行机器人手术。